AUTOR

Miquel Àngel Fuentes Arjona és professor d’anglès a un centre públic d’educació secundària i FP. També ha exercit com a formador en competència digital docent a diversos cursos del Departament d’Educació de Catalunya. En els darrers cursos, ha estat implicat en la creació de materials educatius i en les formacions del projecte ‘Intel·ligència artificial en educació’ de XTEC.

X @miquelangel_f BlueSky @miquelangelfuentes.bsky.social

Abstract

La introducció de la intel·ligència artificial generativa (IAG) a l’àmbit educatiu ofereix oportunitats valuoses per a l’aprenentatge personalitzat, però també planteja desafiaments ètics, socials i culturals. Un dels més rellevants és el seu impacte eLa introducció de la intel·ligència artificial generativa (IAG) a l’àmbit educatiu ofereix oportunitats valuoses per a l’aprenentatge personalitzat, però també planteja desafiaments ètics, socials i culturals. Un dels més rellevants és el seu impacte en la perpetuació de desigualtats de gènere i en la proliferació de noves formes de violència digital, com ara els deepfakes i el contingut manipulat sense consentiment. Diversos casos a Espanya demostren que menors poden utilitzar aquestes eines per crear imatges falses de nus, cosa que subratlla la urgència per abordar la competència digital des de la perspectiva de gènere.

Integrar la coeducació i la ciutadania digital a l’educació sobre IAG és necessari per evitar que els avenços tecnològics reprodueixin dinàmiques de discriminació i violència. La perspectiva de gènere permet identificar i desafiar desigualtats i fomentar el respecte, l’empatia i el consentiment en entorns digitals. És per això que els docents tenim la responsabilitat de proporcionar un marc ètic i crític en lús daquestes tecnologies, i garantir que lalumnat desenvolupi habilitats digitals alineades amb valors digualtat i justícia social.

Així mateix, és crucial que les famílies, els centres educatius i les autoritats treballin de manera conjunta per establir protocols de prevenció i actuació davant de situacions d’abús digital. La formació del professorat en perspectiva de gènere, el suport a les víctimes i el desenvolupament de polítiques educatives inclusives són estratègies imprescindibles per afrontar aquests desafiaments.

Per acabar, abordar la interseccionalitat entre els usos ètics de la IA, la ciutadania digital i la igualtat de gènere no només pot prevenir els mals usos de la IAG, sinó que també pot promoure una cultura digital més conscient i equitativa. D’aquesta manera, l’educació es pot convertir en un motor de canvi cap a un futur en què la tecnologia serveixi per al progrés social i no perpetuï les desigualtats.

Paraules clau

intel·ligència artificial generativa (IAG), perspectiva de gènere, coeducació, hipertrucatges

Per un aprenentatge personalitzat amb perspectiva de gènere

La integració de la intel·ligència artificial generativa (IAG) en l’àmbit educatiu sovint s’associa amb l’aprenentatge personalitzat, entès com l’adaptació de continguts, ritmes i estratègies pedagògiques a les necessitats, els interessos i les característiques individuals de l’alumnat (UNESCO, 2017, p. 5). La relació entre la perspectiva de gènere, la IAG i l’aprenentatge personalitzat es basa en l’aspiració de formar individus competents i autònoms, a la vegada que compromesos amb la igualtat, la justícia i la dignitat humana. Situar l’alumnat al centre del procés educatiu implica reconèixer els seus interessos, passions i aspiracions (Bray & McClaskey, 2017, p. 7). Però perquè aquest procés sigui realment inclusiu, cal que aquesta personalització es produeixi dins d’un marc que defensi la convivència i el respecte mutu. Com a docents, hem de garantir que cap avenç tecnològic, per útil que sigui, es converteixi en un vehicle per a la reproducció de desigualtats o violències.

Abans del boom de la IAG amb l’arribada de ChatGPT el 2022, ja es pot trobar literatura que aborda els problemes de perspectiva de gènere en la IA. Scheuerman, Paul & Brubaker (2019) adverteixen de biaixos en la tecnologia de reconeixement facial contra persones trans, i insten a implementar polítiques sensibles al gènere i a crear conjunts de dades inclusius per reduir biaixos. Cernadas & Calvo-Iglesias (2020) també esmenten els biaixos en els conjunts de dades en sistemes de visió artificial i defensen polítiques que requereixin la integració de la perspectiva de gènere en l’educació sobre IA.

La irrupció de la IAG en l’àmbit educatiu planteja importants reptes ètics, legals, socials i culturals. Lluny de ser una qüestió merament tècnica, el desenvolupament i aplicació de models capaços de generar imatges, textos i altres continguts a partir de dades ha obert noves possibilitats, però també ha exposat una sèrie de problemàtiques emergents que demanen una resposta educativa integral. Entre aquestes preocupacions destaquen els anomenats hipertrucatges (deepfakes): continguts audiovisuals creats amb IAG que simulen situacions i persones de manera tan realista que resulta difícil distingir-los de la realitat. Aquest fenomen, fins fa poc circumscrit a figures públiques amb un ampli repositori de dades, s’ha estès a entorns més propers i està afectant menors d’edat i entorns escolars.

Davant d’aquest nou escenari, els docents necessitem un enfocament educatiu holístic que integri la perspectiva de gènere, la ciutadania digital i els usos responsables de les tecnologies. És aquí on entra en joc la coeducació (la pràctica educativa del marc teòric que proporciona la perspectiva de gènere), que és un dels objectius recollits en el marc internacional dels ODS de les Nacions Unides. A Catalunya, el decret 175/2022, de 27 de setembre, d’ordenació dels ensenyaments de l’educació bàsica especifica que “la incorporació de la coeducació, en tant que principi rector del sistema educatiu i criteri orientador de l’organització pedagògica dels centres, a tots els nivells i modalitats, és cabdal per afavorir el desenvolupament de les persones al marge dels estereotips i rols en funció del sexe, l’orientació sexual, la identitat o l’expressió de gènere” (p. 2). La centralitat d’aquest vector ha portat, entre altres accions, a la publicació del document “El vector de perspectiva de gènere en les situacions d’aprenentatge” (Pallàs & Navés, 2024).

El cas Almendralejo obre el debat sobre l’estat de la qüestió

El 18 d’agost de 2023 va aparèixer a les notícies el conegut com a “cas Almendralejo”. Aquest cas implicava la creació i difusió d’imatges falses de nus de menors creades amb eines amb IAG a la localitat d’Almendralejo, Badajoz. El 20 d’octubre del 2023 apareixen més dades: un grup de menors, d’entre 12 i 14 anys, havia generat i distribuït imatges falses de nus d’almenys 22 nenes del seu entorn. Creades utilitzant eines amb IAG, les imatges s’havien compartit mitjançant WhatsApp i Telegram. El cas va tenir una gran repercussió mediàtica, arribant fins i tot a tenir cobertura internacional.

Aquest cas va mobilitzar el debat sobre l’estat de la qüestió. El 19 d’agost de 2023, VerificaRTVE va publicar una guia per a les víctimes de muntatges pornogràfics, amb mencions a institucions com els punts d’atenció primerenca a les víctimes. Més endavant, el 23 d’agost de 2023, RTVE va publicar un article abordant com es jutja a Espanya el porno sintètic sense consentiment. En aquest article, s’apunta que el 96% del contingut creat per IAG correspon a pornografia no consentida, afectant gairebé exclusivament dones. En casos que involucren menors, com el d’Almendralejo, en els quals es van generar imatges falses de nus de nenes, aquests actes es poden considerar delictes de pornografia infantil. L’article fa èmfasi en la necessitat d’una actualització de les lleis per abordar eficaçment els reptes que planteja la IAG en la creació de contingut sexual no consentit.

El 29 de setembre de 2023, RTVE va publicar un altre article sobre aquesta temàtica, aquesta vegada sobre la legislació de les eines amb IAG. En aquest sentit, la Unió Europea està desenvolupant regulacions per reforçar la protecció dels ciutadans davant de ciberdelictes, incloent-hi la implementació de filtres d’edat i l’obligació d’informar sobre falsificacions. Posteriorment, el 2 d’octubre del 2023, Miriam Al Adib Mendiri, mare d’una de les nenes afectades i ginecòloga, va oferir una entrevista en la qual va detallar com s’havia assabentat de l’incident i la seva decisió de no ignorar la situació. La doctora va destacar la importància d’educar els joves sobre l’ús responsable de la tecnologia i la necessitat de suport a les víctimes.

És a partir d’aquest moment quan comencen a sorgir casos similars reflectits a la premsa. El 24 d’octubre del 2023 s’identifica un incident a Barcelona, seguit d’un altre a Mallorca el 4 d’abril de 2024 i un tercer cas a Sevilla el 5 d’agost de 2024. Les autoritats subratllen que, en molts casos, la identificació dels responsables resulta complexa. A més, no totes les víctimes presenten denúncies, fet que contribueix al fet que nombrosos casos passin desapercebuts i no rebin cobertura mediàtica.

Encara que aquesta problemàtica no és nova (eines d’edició d’imatge com Photoshop han estat popularment utilitzades amb aquests fins), el que sí que ha canviat és la seva escalabilitat. Les aplicacions d’IAG permeten generar imatges manipulades de manera ràpida i amb un alt grau de realisme. Aquesta facilitat d‟ús, combinada amb l’accessibilitat que ofereixen les aplicacions web i mòbils, amplia significativament el nombre d’usuaris que poden utilitzar aquestes eines, la qual cosa incrementa l’abast i el risc associat a aquestes pràctiques. Per exemple, el 29 de gener de 2024, 3Cat va informar que les cerques de la cantant nord-americana Taylor Swift havien estat temporalment bloquejades a la xarxa social X (abans Twitter), per poder contrarestar la inundació d’hipertrucatges sexuals de l’artista que havien estat compartits a la plataforma durant la setmana anterior.

Com de comunes són aquestes pràctiques entre menors? Als Estats Units, l’agost del 2024, l’ONG Thorn va publicar l’informe Youth Perspectives on Online Safety 2023. L’enquesta, realitzada en línia entre el 3 de novembre i l’1 de desembre del 2023, va formular preguntes a 1.040 menors d’entre 9 i 17 anys sobre material sexual i experiències perjudicials en línia. Un dels ítems que més va captar l’interès de la premsa va ser el nou ítem QB4: “Que tu sàpigues, algun dels teus amics o companys de classe ha fet servir alguna vegada eines d’IA per generar nus d’altres nens?

Figura 1. Captura del gràfic resultant de l’ítem QB4 de l’informe Youth Perspectives on Online Safety 2023.

El resultat va ser d’un notable 1 de cada 10, juntament amb un altre 1 de cada 10 que va preferir no respondre.

L’enquesta de Thorn és un dels primers intents de quantificar l’abast del problema. L’informe assenyala la necessitat que la indústria tecnològica abordi els riscos de la IAG per als infants, però destaca que això no ha d’endarrerir la intervenció sobre els comportaments nocius associats, com ara el bullying i l’assetjament. També subratlla la importància d’un enfocament proactiu per abordar els danys causats pels hipertrucatges i reforçar l’educació sobre conductes inacceptables a les comunitats i escoles, més enllà de la tecnologia utilitzada (p. 13).

A més dels mals usos de les eines per modificar imatges, altres usos de la IAG també plantegen problemes ètics i de perspectiva de gènere que han estat recollits a la premsa. Per exemple, el 21 de desembre de 2023, RTVE va informar sobre la creació de la influencer virtual Aitana López, desenvolupada mitjançant IAG. L’aparició i la proliferació d’aquests usos comercials subratlla problemàtiques relacionades amb la representació femenina, l’explotació i la cosificació de les dones en entorns digitals, i contribueix a perpetuar la idea de les dones com a objectes de consum. Posteriorment, el 7 de març de 2024, RTVE va tractar el concurs de bellesa “Miss AI“, protagonitzat per models generades per IAG. Aquest cas no només reforça les preocupacions sobre els estereotips de gènere i la cosificació, sinó que també planteja interrogants sobre les implicacions socials i culturals de reemplaçar les dones reals per creacions sintètiques, mancades d’agència i veu pròpia. Ambdós exemples il·lustren com aquestes tecnologies no només repliquen, sinó que amplifiquen dinàmiques de desigualtat de gènere en els entorns digitals.

La capacitat de crear imatges falses i contingut sexualitzat sense consentiment, i de difondre’l a escala global, no és només un problema tècnic o legal. Aquest és sobretot un problema social, ètic i amb un component elemental de gènere. Les nenes i dones solen ser les principals víctimes d’aquests abusos, veient-se exposades a violència de gènere digital, extorsió sexual (sextorsió) i danys irreparables en la seva reputació. Molts d’aquests comportaments nocius sorgeixen en entorns on els estereotips, les actituds sexistes i la manca de sensibilitat davant el consentiment i el respecte a la dignitat aliena en faciliten l’aparició. La coeducació suposa un vehicle per prevenir aquestes dinàmiques. La formació en competència digital i el foment del pensament crític adquireixen una nova dimensió quan es tracta de detectar, prevenir i respondre a la creació d’hipertrucatges i altres usos malintencionats de la IAG.

Com a docents, hem de ser conscients que l’arrel d’aquest problema no rau únicament en la curiositat tecnològica de l’alumnat, sinó en la manca d’educació en valors, en el desconeixement de les conseqüències legals i emocionals, i en la reproducció d’estereotips de gènere que trivialitzen la violència digital contra les dones. En aquest context, la coeducació té un paper protagonista en subratllar la necessitat d’entendre aquestes pràctiques com a actes de violència de gènere digital i no com a simples “bromes” o “coses de nois”.

La interseccionalitat entre els usos ètics de la IA, ciutadania digital i perspectiva de gènere

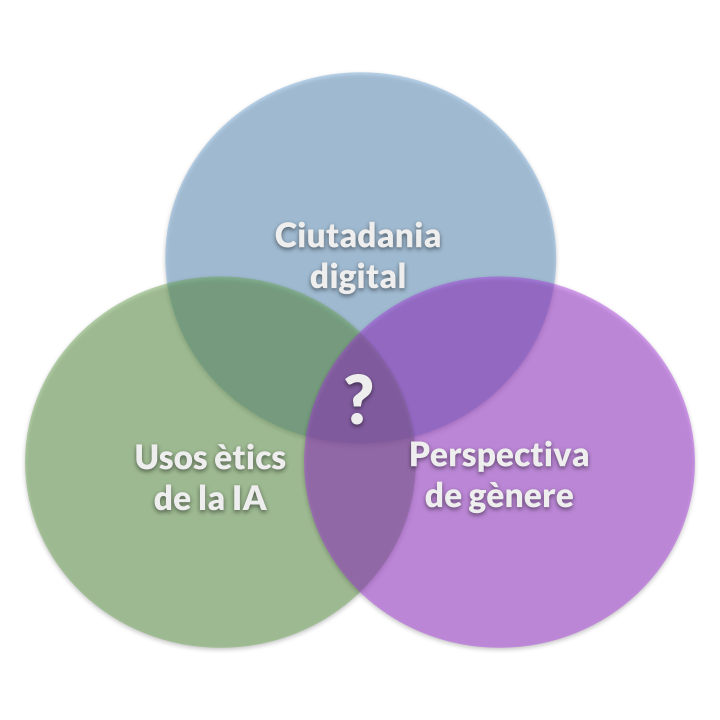

Figura 2. Diagrama de Venn sobre la interseccionalitat entre ciutadania digital, usos ètics de la IA i perspectiva de gènere, amb un interrogant al centre.

Un concepte clau per entendre aquesta situació és el d’interseccionalitat. Els docents ens enfrontem a una problemàtica que combina els usos ètics de la IA, la ciutadania digital i la perspectiva de gènere. Docents, famílies i alumnat estem descobrint, alhora, com resoldre aquest nou problema a la societat i a les aules. Per donar-hi resposta, no n’hi ha prou amb abordar cadascun d’aquests components de manera aïllada. La confluència d’aquestes dimensions crea un escenari complex que exigeix respostes igualment complexes. No podem limitar-nos a millorar la competència digital de l’alumnat sense qüestionar els valors i actituds que guien l’ús d’aquestes competències.

La coeducació aporta una visió interseccional que té en compte com les desigualtats de gènere s’entrellacen amb les bretxes digitals i amb els usos problemàtics de la tecnologia. Aquesta aproximació ens anima a replantejar el nostre currículum per integrar l’alfabetització mediàtica i digital amb l’educació afectivosexual i la sensibilització davant la violència de gènere. En assumir aquesta responsabilitat, un centre educatiu es pot transformar en un espai d’empoderament en el qual l’alumnat no només aprengui a detectar hipertrucatges, sinó també a rebutjar pràctiques digitals nocives i a qüestionar problemes de gènere.

El problema dels hipertrucatges compta, actualment, amb molta menys visibilitat de la que caldria en el panorama educatiu sobre IA. Molts divulgadors d’IA en educació se senten fora de la zona de confort en abordar temes com aquest. Es tem que afrontar aquestes pràctiques tingui un efecte contrari i en fomenti l’ús, o que presenti la IA sota una llum negativa. Tot i això, silenciar el problema mai és la solució. La coeducació ens insta a enfrontar-nos a aquestes realitats, a mostrar-ne les conseqüències i a proporcionar a l’alumnat les eines per reflexionar i actuar èticament.

Riscos específics dels hipertrucatges

Per entendre millor l’abast de la problemàtica, Leon Furze, a l’article We need to talk about deepfakes (2024), identifica els majors riscos dels hipertrucatges:

- Hipertrucatges explícits creats sense consentiment: la producció d’imatges o vídeos sexualitzats sense el consentiment de la persona retratada constitueix una forma de violència greu que atempta contra la dignitat i la intimitat.

- Xantatge, extorsió i sextorsió: la creació de contingut fals pot ser utilitzada per coaccionar les víctimes, exigint diners o favors sexuals, entre altres tipus de coaccions, sota l’amenaça de difondre el material.

- Dany reputacional: un hipertrucatge no només humilia la víctima, sinó que pot destruir la seva reputació personal, escolar i fins i tot professional, amb conseqüències psicològiques devastadores.

- Desinformació i notícies enganyoses: més enllà de l’àmbit escolar, els hipertrucatges també poden alimentar narratives falses i manipular l’opinió pública, cosa que pot soscavar la confiança en la informació veraç i les institucions.

Què poden fer els centres educatius i els docents davant d’aquesta situació? Furze proposa una sèrie de mesures que, integrades en el marc de la coeducació, poden ajudar a situar els docents:

- Legislació i criminalització: els centres educatius han de conèixer les lleis que regulen els hipertrucatges, la violència de gènere digital i la privacitat. Han de treballar amb l’entorn jurídic i donar suport a l’aprovació de normativa que protegeixi les víctimes i condemnin els responsables. La coeducació pot ajudar a contextualitzar aquestes lleis en un marc restauratiu, evitant una visió merament punitiva.

- Prevenció i educació: promoure campanyes de conscienciació i formació específica. Això podria incloure xerrades amb experts en ciberseguretat, tallers sobre consentiment i privadesa digital, i la integració d’aquests continguts en matèries transversals.

- Polítiques i gestió del risc: els centres educatius han de comptar amb protocols clars per reaccionar davant de casos d’hipertrucatges. Aquests protocols han d’especificar els passos que cal seguir, a qui contactar, com protegir la víctima i com garantir un enfocament restauratiu. La coeducació assegura que aquestes respostes no es limitin a la sanció sinó que incloguin la reflexió, l’empatia i el canvi d’actituds.

- Suport a les víctimes: quan un menor és víctima d’un hipertrucatge, necessita suport immediat del seu entorn i assessorament psicològic, vies per denunciar la situació i ajuda per eliminar el contingut de la xarxa. Des de la coeducació es destaca que cada cas és una oportunitat per a l’aprenentatge col·lectiu. La comunitat escolar ha de mostrar solidaritat amb la víctima i un rebuig ferm a la violència, per tal de reforçar així el missatge que aquestes conductes no tenen cabuda en un entorn educatiu que aspira a la igualtat i respecte.

La implicació de les famílies en aquest objectiu

La inacció és el pitjor dels camins. La realitat ja és aquí, amb menors practicant aquest tipus d’abusos. L’absència d’un abordatge formatiu no evitarà que passin, però sí que impedirà que l’alumnat prengui consciència del dany que provoquen i que se senti preparat per evitar-los o denunciar-los.

El 18 de novembre de 2024, Ars Technica va publicar un article sobre un cas en una escola de Pensilvània, als Estats Units. En aquesta escola, un alumne va crear i difondre imatges explícites de gairebé 50 companyes creades amb IAG. L’agost del 2024, l’alumne va ser arrestat. Indignades per la inacció de l’escola, les famílies de les víctimes van presentar una demanda i van exigir la renúncia dels càrrecs directius. Davant la pressió, l’escola es va veure forçada a cancel·lar les classes temporalment i va oferir suport a la comunitat. Tot i això, les famílies van continuar amb la demanda per la manca de resposta adequada per part del centre davant l’abús sofert per les alumnes.

La implicació de les famílies en aquest discurs és bàsica, ja que és el primer espai on s’inculquen valors de respecte i igualtat. En treballar conjuntament amb el centre educatiu, es reforça la idea d’un ús responsable de la tecnologia, i es pot conscienciar els menors sobre els perills de crear o distribuir continguts inapropiats generats amb IAG. Aquesta col·laboració pot ajudar a fer que l’alumnat comprengui les implicacions ètiques d’aquestes tecnologies i fomenti una ciutadania digital que respecti els drets de totes les persones. Es pot mobilitzar, per exemple, de manera síncrona, mitjançant la implementació de tallers i xerrades formatives, o de manera asíncrona mitjançant la publicació de guies i recursos formatius. Només amb un esforç conjunt entre famílies, docents i alumnat es pot garantir que la IAG sigui una eina que promogui l’equitat i no perpetuï desigualtats ni violències de gènere.

El paper exemplaritzant del docent

Els docents ens hem de formar no només en els aspectes tècnics d’aquesta tecnologia, sinó també en els seus usos des de la perspectiva de gènere. Tot i que pugui ser incòmode, és imprescindible. Els docents tenim la responsabilitat de ser referents ètics i de mostrar una actitud compromesa amb la igualtat i la justícia social.

Existeix una àmplia literatura sobre la importància de construir un espai segur en educació. Per exemple, a l’article Cultivating the Classroom as a Safe Space for Middle and High School Students del blog Edutopia (2021), Fievre destaca la importància de crear entorns d’aprenentatge en els quals l’alumnat pugui sentir-se lliure per cometre errors sense por a judicis o al ridícul, i hi pugui participar de manera crítica i honesta quan es tractin temes delicats. També posa en relleu aspectes com ara mostrar compassió i comprensió, especialment en moments de crisi.

Quant a tractar temes delicats a l’aula, a l’article d’Edutopia Creating a Safe Space for Students to Discuss Sensitive Current Events (2015), Alrubail proposa estratègies com informar sobre els recursos disponibles, fomentar reflexions escrites, proporcionar lectures relacionades, facilitar debats en grup o fomentar la reflexió personal. De manera relacionada, Bowerman, al seu article Building a Trauma-Sensitive Space (2023), destaca la importància de proporcionar a l’alumnat espais segurs on es puguin retirar quan pateixen estrès o crisis emocionals. Oferir aquests espais dins l’entorn escolar reconeix i valida la necessitat de l’alumnat de tenir un lloc per processar les seves emocions, fet que pot contribuir al seu benestar general i a crear un ambient d’aprenentatge més inclusiu i comprensiu.

L’alumnat necessita saber que pot parlar d’aquests temes amb els docents, que no els jutjaran ni minimitzaran el problema, sinó que oferiran acompanyament i solucions. La coeducació torna a ser una brúixola: hem d’utilitzar-la per guiar-nos en la creació d’entorns segurs, lliures de discriminacions i violències.

Conclusions

Els hipertrucatges, la possibilitat de generar imatges sense consentiment i les múltiples formes d’abús digital associades a la IAG ens interpel·len com a docents. No podem ignorar aquests fenòmens ni diluir-los en un discurs merament tècnic. La coeducació ofereix un dels marcs més importants per abordar l’ús ètic de la tecnologia, el respecte a la dignitat humana i la promoció de relacions igualitàries, amb l’objectiu de prevenir i erradicar aquestes noves formes de violència.

En aquest context, és fonamental que els centres educatius prenguin mesures concretes per integrar la coeducació i l’alfabetització mediàtica a les seves pràctiques. Des de tallers sobre ciutadania digital fins a projectes col·laboratius que fomentin el pensament crític, cada iniciativa compta per formar un alumnat conscient i empàtic. Convidem docents, famílies i responsables educatius a unir-se en el disseny d’estratègies que no només sensibilitzin sobre els riscos de la IAG, sinó que també promoguin un ús responsable i equitatiu d’aquestes tecnologies. L’educació és l’eina més poderosa que tenim per transformar aquests reptes en oportunitats d’aprenentatge i creixement.

En integrar la coeducació a la formació sobre IAG, estem construint una cultura digital més justa i conscient, capaç d’afrontar els reptes sense perdre de vista els principis bàsics de la dignitat, el respecte i la igualtat. Aquest és el camí perquè el centre escolar, en el paper formador, acompanyi les noves generacions en la construcció d’un futur digital inclusiu i ètic. D’aquesta manera, podrem formar ciutadans que entenguin que la tecnologia, utilitzada de manera responsable i amb perspectiva de gènere, és un mitjà per al progrés social i no una eina d’abús. I aquest seria, en última instància, un dels èxits educatius més grans als quals podem aspirar.

Referències bibliogràfiques

Alrubail, R. (2015). Creating a safe space for students to discuss sensitive current events. Edutopia. Recuperat de https://www.edutopia.org/discussion/creating-safe-space-students-discuss-sensitive-current-events

Bray, B. & McClaskey, K. a Beresford, T. (2017). Human-scale at scale: Cultivating new education cultures. Innovation Unit. https://www.innovationunit.org/wp-content/uploads/Human-scale-at-Scale_report_FINALcompressed.pdf

Bowerman, M. J. (2023). Building a trauma-sensitive space. Edutopia. Recuperat de https://www.edutopia.org/article/creating-trauma-safe-spaces-in-school/

Cernadas, E., & Calvo-Iglesias, E. (2020). Gender perspective in artificial intelligence (AI). Eighth international conference on technological ecosystems for enhancing multiculturality (pp. 173-176). https://dl.acm.org/doi/abs/10.1145/3434780.3436658

Fievre, M. J. (2021). Cultivating the classroom as a safe space. Edutopia. Recuperat de https://www.edutopia.org/article/cultivating-classroom-safe-space/

Furze, L. (2024). We need to talk about deepfakes. Recuperat de https://leonfurze.com/2024/09/11/we-need-to-talk-about-deepfakes/

Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura. (2017). Educación para los Objetivos de Desarrollo Sostenible: objetivos de aprendizaje. UNESCO. https://unesdoc.unesco.org/ark:/48223/pf0000250057_spa

Pallàs, K., & Navés, T. (2024). El vector de perspectiva de gènere en les situacions d’aprenentatge: Orientacions, estratègies i fonaments per al desplegament efectiu del vector de perspectiva de gènere en el currículum d’infantil i de l’ensenyament bàsic. Generalitat de Catalunya, Direcció General d’Innovació, Digitalització i Currículum. https://projectes.xtec.cat/nou-curriculum/wp-content/uploads/usu2072/2024/09/MARC-TEORIC-VECTOR-GENERE.pdf

Scheuerman, M. K., Paul, J. M., & Brubaker, J. R. (2019). How computers see gender: An evaluation of gender classification in commercial facial analysis services. Proceedings of the ACM on Human-Computer Interaction, 3(CSCW), 1-33. https://dl.acm.org/doi/abs/10.1145/3359246Thorn. (2024). Youth perspectives on online safety, 2023. https://info.thorn.org/hubfs/Research/Thorn_23_YouthMonitoring_Report.pdf